这就是Lucas Pope在2018年发布的独立游戏《Return of the Obra Dinn》(下文简称Obra Dinn)。它拿下了当年TGA最佳美术指导,次年GDC独立游戏节大奖、BAFTA最佳游戏设计与艺术成就奖、以及游戏开发者选择奖最佳叙事奖——几乎横扫了独立游戏能拿到的所有制高点。

通关之后,我反复在想:这个游戏到底对在哪里?资料调查下来,我认为答案分布在三个维度。

一、视觉构筑:1-bit美学的工程学

Obra Dinn的视觉风格几乎不需要描述——黑白两色,粗粒感的抖动渲染(dithering),轮廓清晰的低多边形3D场景。但这个风格不是为了”复古”而复古,它是一套经过反复工程计算的表达系统。

Pope在TIGSource开发日志中详细记录了这一过程。游戏的视觉灵感来自他童年玩过的早期Macintosh游戏——512×342分辨率,9英寸屏幕,纯黑白显示。他说:

“I specifically remember never thinking ‘I want more colors here.’ To me it always looked beautiful in one bit.”

但把1-bit风格用于现代3D游戏,最大的工程难题是抖动(dithering)的动态稳定性。传统的抖动算法在动态画面中会产生像素闪烁,让玩家眼睛无法承受。Pope花了四年时间反复实验,他的解法是:不把抖动当成”模拟灰度的手段”,而是让它成为依附在3D几何体表面的稳定纹理——像木刻版画一样跟随物体移动,而不是在屏幕像素上随机跳动。

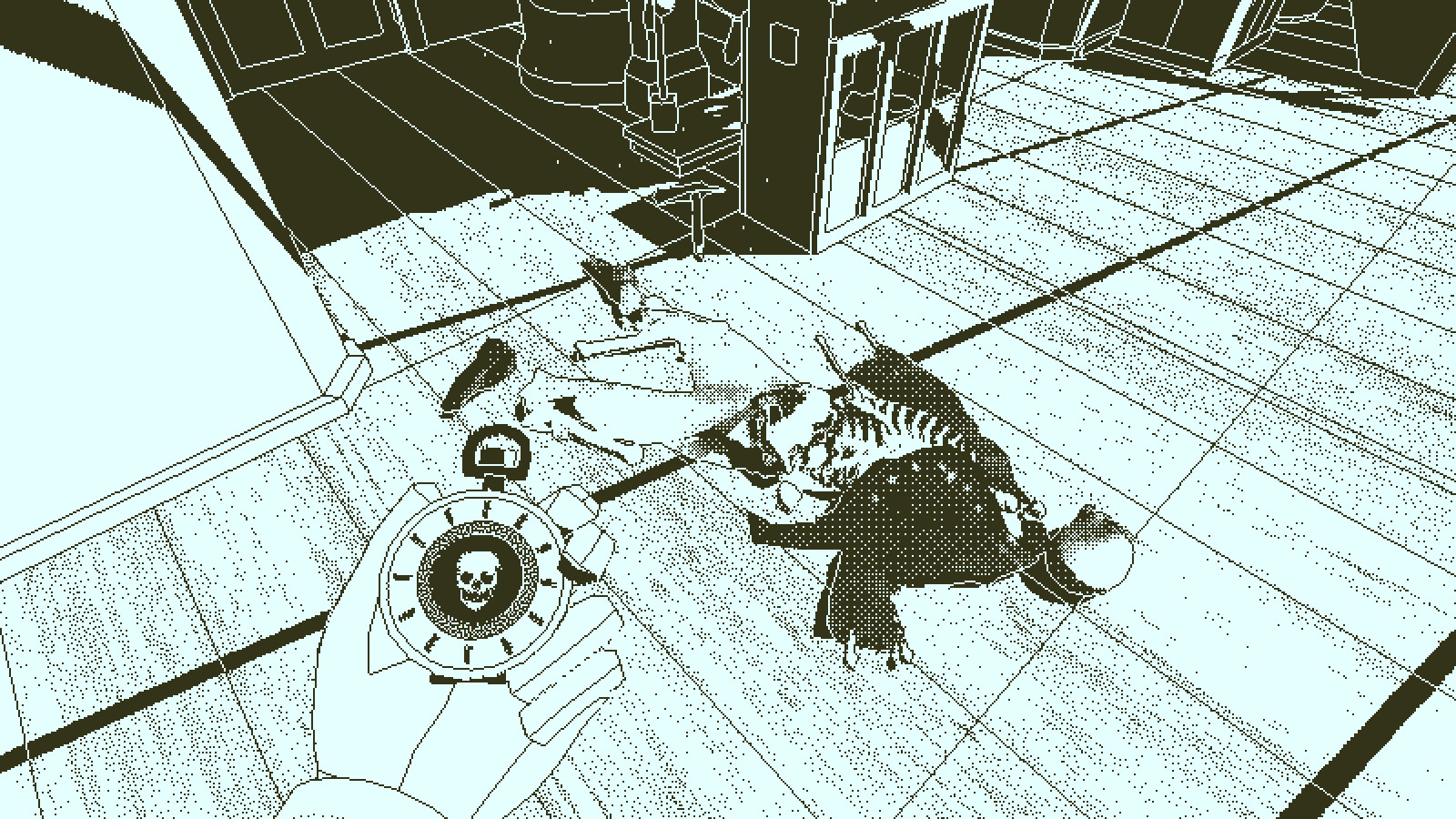

定格在死亡瞬间的船舱——黑白两色构建出比彩色更具压迫感的空间

定格在死亡瞬间的船舱——黑白两色构建出比彩色更具压迫感的空间

另一个关键决策是轮廓线规则:明亮背景上的物体用黑色描边,黑暗背景上的物体用白色描边——始终保持反色,确保几何形状可辨认。这个看起来简单的规则,让Obra Dinn的场景在任何光线条件下都保持空间清晰,同时彻底回避了恐怖游戏式的”藏东西”,Pope说这是刻意的:他不想让玩家迷失,他想让玩家观察。

批评游戏研究学者(CVGS)的视觉分析指出,这套美学与19世纪盛行的蚀刻版画和木刻版画在视觉语法上高度吻合——那正是Obra Dinn故事发生的年代。形式即内容。

每一次目击死亡,都是闯入一张凝固的蚀刻版画

每一次目击死亡,都是闯入一张凝固的蚀刻版画

二、叙事结构:记忆的考古学

Obra Dinn的叙事是非线性的,但它的非线性不是《低俗小说》式的炫技,而是有其内在逻辑——你只能看见死亡的那一刻,不能看见死亡之前或之后发生的一切。

这个限制塑造了全部的叙事张力。

游戏分十个章节,每章覆盖Obra Dinn航行中的一段时期。玩家在2007年的”现在”探索空船,找到遗骨,触发怀表,进入死亡定格。但章节本身是有顺序的,故事却是碎片化的:同一个人可能出现在多个章节里,早期的章节可能交代的是晚期事件,而解开一个死因往往需要回到更早发生的场景中去寻找线索。

Stories in Play的学术分析将这种结构称为”空间化的时间”(spatialized time):同一艘船,在”现在”是空壳,在”记忆”里是满载的活人——两个时态同时叠放在同一个物理空间上,让玩家在每次进出记忆时都感受到一种近乎考古学的落差感。

叙事密度也是这个游戏的惊人之处。Gamedeveloper的专访中,Pope提到游戏的核心设计动机之一就是”fascinating design problems”——他给自己设了很多限制,包括:所有信息都必须通过场景的视觉和听觉自然呈现,没有任何人会为了给玩家线索而说话。每一句台词都是那个场景中那个人物在那个情境下真实会说的话,却同时包含着能够帮助玩家推理的信息量。

这种密度在通关之后还会带来惊喜。Gold-Plated Games的评测写道:

“After I completed every fate, I went back to look at guides to help me sort out the story and discovered I had missed fully half the clues in the game with my educated guessing.”

信息层叠得如此深,以至于不少玩家靠猜测完成了推理,却不知道自己错过了多少指向同一答案的线索。

三、推理设计:公平的折磨

Obra Dinn最难的部分不是找线索,而是相信自己找到了足够的线索。

游戏的推理系统有一个巧妙的”三连确认”(confirmation in sets of threes)机制:当你在日志中填入三个正确的判断(姓名+死因+责任人),系统才会确认并锁定这三条,给出”Well Done”的反馈。单独一条正确的填写得不到任何反馈。这个设计的用意在于:让玩家通过交叉验证积累信心,而不是逐条暴力猜测。

Intermittent Mechanism的分析文章细致拆解了这个系统如何在实践中产生”有根据的猜测”循环——当玩家对两个身份有把握时,往往会开始用第三个身份来”测试”系统,这在某种程度上偏离了Pope希望玩家通过观察得出答案的设计初衷。

但这个张力本身也揭示了游戏推理设计最难的挑战:如何在信息量巨大的谜题中,保持推理而非猜测的尊严?

Obra Dinn的解法是多层次的:

- 种族、口音、职位:同职级的船员往往聚在一起;语言差异提供了归属线索

- 空间关系:死亡场景中的站位往往暗示关系,而关系可以交叉验证

- 跨场景积累:一个在早期场景出现过的面孔,到后期场景往往能凭已知信息锁定

- 语音与对话的细节:被叫到的名字、提到的称呼,都是线索

Kellie Lu的分析文章精准捕捉了这个游戏的核心体验:”unlike many detective games that give the player god-like powers or modes to highlight clues, the player must investigate environments without hand-holding”——它让玩家成为真正的侦探,而不是在模拟侦探的过场动画里按提示键。

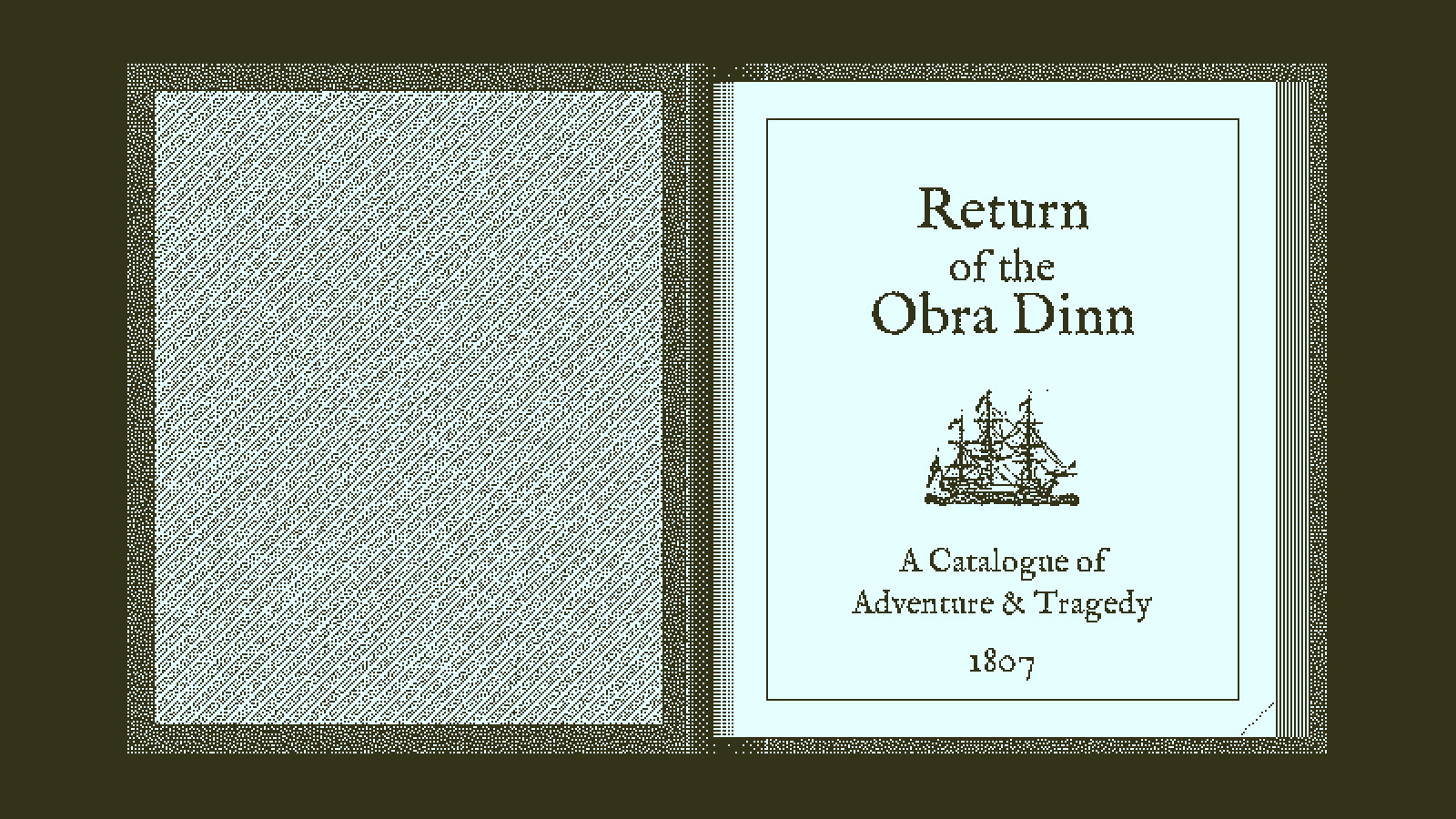

日志本——既是游戏的UI,也是叙事的容器

日志本——既是游戏的UI,也是叙事的容器

结尾

Obra Dinn让我印象最深的一刻,不是解出某个特别难的死因,而是在通关后意识到:那艘船上60个人的命运,都有一个完整的、自洽的因果链;游戏没有为了谜题的难度而发明不合理的死法,没有为了叙事的戏剧性而牺牲推理的严密——它在两者之间找到了一个极其罕见的均衡点。

Lucas Pope把这个游戏描述为”an insurance adventure with minimal colour”。克制到近乎冷漠——但正是这份克制,让那些偶尔出现的情绪力量有了真正的重量。

参考资料

- Lucas Pope (2018). For Obra Dinn, it was a bunch of appealing design problems. Game Developer

- Lucas Pope (2014–2018). Return of the Obra Dinn - TIGSource Development Log. TIGSource Forums

- Jason Boyd (2020). Return of the Obra Dinn - Stories in Play. storiesinplay.com

- CVGS (2022). Return of the Obra Dinn: A Visual Analysis. criticalvideogamestudies.com

- Gold-Plated Games (2019). Review: Return of the Obra Dinn. goldplatedgames.com

- Elle Thompson (2024). Confirmation in The Return of Obra Dinn. intermittentmechanism.blog

- Kellie Lu. Analysis of Return of the Obra Dinn. kellielu.squarespace.com

《勇者斗恶龙XI:寻觅逝去的时光》——系列基因最完整的一部集大成之作

《勇者斗恶龙XI:寻觅逝去的时光》——系列基因最完整的一部集大成之作 《火焰纹章:风花雪月》——角色培养机制的集大成,每一条支援线都是独立的人物故事

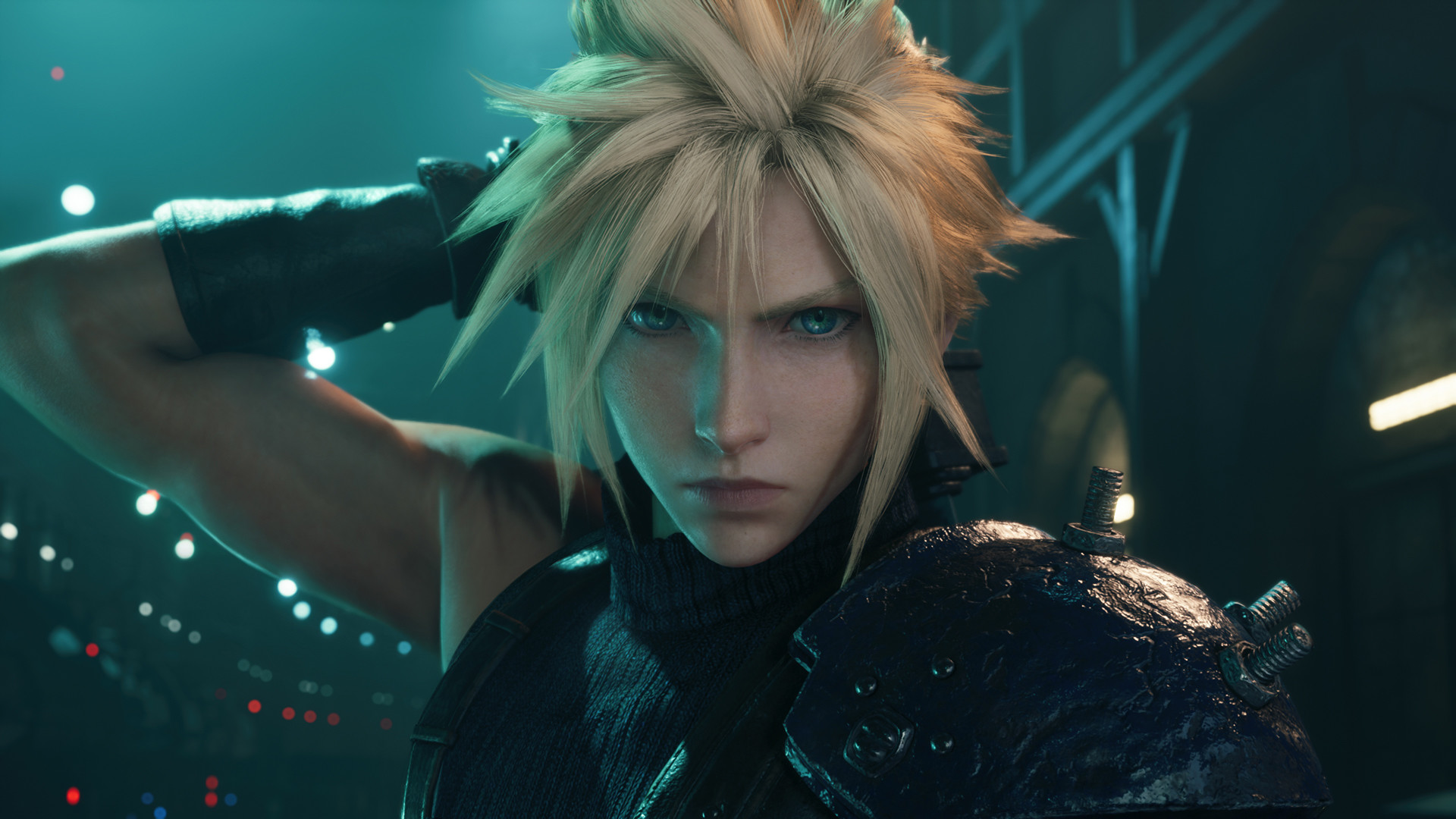

《火焰纹章:风花雪月》——角色培养机制的集大成,每一条支援线都是独立的人物故事 《最终幻想VII Remake》——将物哀美学贯穿始终的史诗重制

《最终幻想VII Remake》——将物哀美学贯穿始终的史诗重制 《女神异闻录5皇家版》——用都市日常节奏重新定义了”JRPG的慢”

《女神异闻录5皇家版》——用都市日常节奏重新定义了”JRPG的慢” 《密特罗德:恐惧》:EMMI机器人的阴影笼罩着整个星球ZDR

《密特罗德:恐惧》:EMMI机器人的阴影笼罩着整个星球ZDR 《恶魔城》DS三部曲:构筑与成长是贯穿全系列的核心乐趣

《恶魔城》DS三部曲:构筑与成长是贯穿全系列的核心乐趣 《血污:夜之仪式》丰富的装备与碎片系统

《血污:夜之仪式》丰富的装备与碎片系统 《空洞骑士》:黑暗美学与护符构筑系统

《空洞骑士》:黑暗美学与护符构筑系统 《波斯王子:失落的王冠》:流畅的动作与扎实的银河恶魔城探索

《波斯王子:失落的王冠》:流畅的动作与扎实的银河恶魔城探索